13 nov (Reuters) – Facebook Inc retiró 3.200 millones de cuentas falsas entre abril y septiembre de este año, junto con millones de publicaciones que describen abuso infantil y suicidio, de acuerdo a su último informe de moderación de contenidos divulgado el miércoles.

La cifra más que duplica el número de cuentas falsas retiradas durante el mismo período del año pasado, cuando 1.550 millones de cuentas fueron removidas, según el informe. (bit.ly/2OcsCVI)

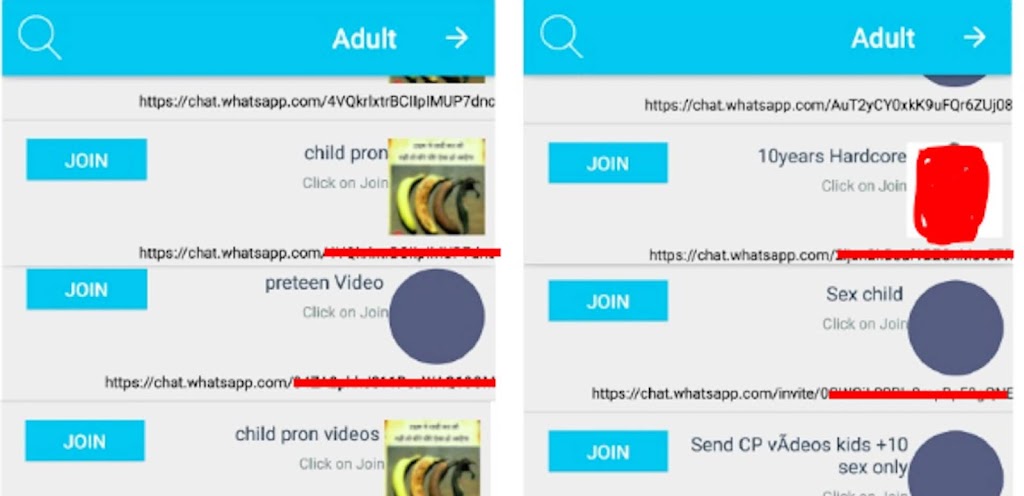

La mayor red social del mundo también divulgó por primera vez cuántas publicaciones retiró de su popular aplicación para compartir fotos Instagram, que se ha convertido en una creciente área de preocupación sobre noticias falsas.

La detección proactiva de contenido prohibido fue menor en Instagram que en la plataforma Facebook, donde la compañía implementó inicialmente muchas de sus herramientas de detección, dijo la firma en su cuarto reporte de moderación de contenido.

Por ejemplo, la firma aseguró que detectó de manera proactiva contenido afiliado a organizaciones terroristas 98,5% del tiempo en Facebook y 92,2% del tiempo en Instagram.

Retiró más de 11,6 millones de piezas de contenido que muestran desnudez infantil y explotación sexual de niños en Facebook y 754.000 en Instagram durante el tercer trimestre.

Facebook (FB.O) también agregó datos sobre acciones que tomó sobre contenido que involucra autolesiones por primera vez en el reporte. Afirmó que retiró alrededor de 2,5 millones de publicaciones en el tercer trimestre que mostraban o alentaban el suicidio o las autolesiones.

La compañía también retiró alrededor de 4,4 millones de piezas relacionadas con la venta de medicamentos durante el trimestre, aseguró en un blog. (bit.ly/33MCdsX)